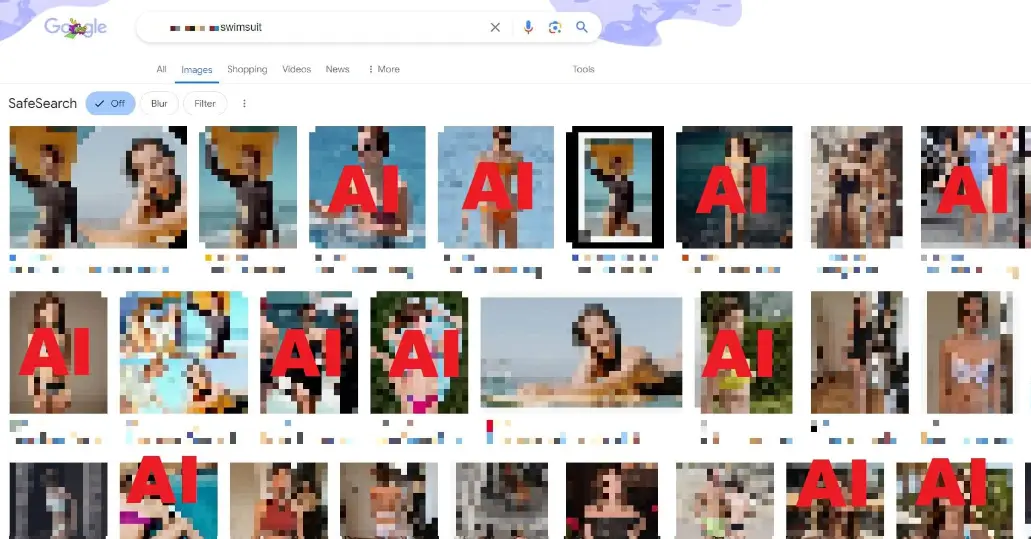

Es momento de hablar del problema de las imágenes generadas por IA en los resultados de búsqueda de Google. Las imágenes generadas por inteligencia artificial (IA) están invadiendo los resultados de búsqueda de Google, presentando a los usuarios fotografías de celebridades en trajes de baño sin ninguna indicación de que estas imágenes sean artificiales. En algunos casos, aunque los términos de búsqueda no soliciten explícitamente contenido generado por IA, Google muestra imágenes de celebridades en trajes de baño que parecen niños menores de edad.

Al hacer clic en estas imágenes, los usuarios son redirigidos a sitios de generación de imágenes por IA, donde encuentran imágenes aún más perturbadoras, incluyendo material explícito y no consensuado de celebridades que parecen menores.

Todo sobre Imágenes Generadas por IA en los Resultados de Búsqueda de Google

El Problema de la IA en la Búsqueda de Imágenes

La creciente presencia de contenido generado por IA en las herramientas que usamos para navegar por internet, como la búsqueda de imágenes de Google, está desbordando la capacidad de estos sistemas para mantener la calidad y veracidad del contenido. Este fenómeno complica aún más la diferenciación entre lo real y lo generado por IA, diluyendo la confianza del usuario en los resultados que obtiene.

Un caso particular ilustró este problema cuando Jason, un reportero, investigaba sobre la invasión de imágenes inapropiadas y estafas en las páginas de fans de celebridades en Facebook. Al buscar una imagen específica de Taylor Swift, Jason descubrió varias imágenes generadas por IA en la pestaña de búsqueda de imágenes de Google. Estas imágenes, aunque algunas eran claramente falsas, aparecían entre los primeros resultados, lo que despertó la curiosidad sobre la prevalencia de este tipo de contenido.

Resultados de Búsqueda Inadecuados y Peligrosos

Al investigar más a fondo, se encontró que las búsquedas de nombres de celebridades femeninas combinadas con términos como “traje de baño” o “bikini” generaban consistentemente imágenes creadas por IA, independientemente de que los términos de búsqueda no mencionaran explícitamente “IA”. Este problema se extendía a búsquedas que incluían a celebridades como niños, lo cual es particularmente preocupante dado el potencial de explotación y abuso.

Google, a través de un portavoz, afirmó que sus sistemas automatizados están diseñados para mostrar las imágenes más relevantes y de alta calidad. Sin embargo, reconocieron que estos sistemas no son infalibles y que a veces muestran contenido que no cumple con sus estándares de calidad. Google está trabajando en mejorar sus herramientas para identificar y etiquetar de manera confiable las imágenes generadas por IA, aunque este proceso aún está en etapas iniciales.

La Falta de Transparencia y Control

A pesar de los esfuerzos de Google, la falta de respuestas específicas sobre por qué se muestran estas imágenes generadas por IA deja muchas preguntas sin resolver. Es evidente que los sistemas automatizados de Google tienden a priorizar imágenes populares o que reciben muchos clics, lo que facilita que contenido artificial ascienda en los resultados de búsqueda. Este problema se agrava cuando los usuarios son redirigidos a sitios de generación de imágenes por IA que no solo presentan más contenido similar, sino que también promueven imágenes inapropiadas de celebridades que parecen menores.

El Peligro de los Sitios de Generación de Imágenes por IA

Al hacer clic en estas imágenes, los usuarios pueden ser llevados a sitios como Playground.com o sdxlturbo.ai, donde se encuentran con una abundancia de imágenes generadas por IA de celebridades en contextos inapropiados. Estos sitios a menudo presentan imágenes tituladas de manera perturbadora, como “[nombre de la celebridad] en la isla de Epstein en bikini”, haciendo referencia a la isla privada de Jeffrey Epstein, conocida por escándalos de abuso infantil.

El motor de recomendación de estos sitios perpetúa el problema, enviando a los usuarios a un ciclo interminable de contenido similar. Este fenómeno demuestra que el material de abuso sexual infantil (CSAM) generado por IA no se limita a la dark web, sino que está accesible en plataformas más visibles, complicando aún más su erradicación.

Las Políticas Inconsistentes de los Sitios de IA

La mayoría de los sitios de generación de imágenes por IA, como Lexica, Neural Love, Prompt Hunt, Night Cafe y Deviantart, tienen políticas que prohíben la pornografía no consensuada y el CSAM. Sin embargo, la aplicación de estas políticas es inconsistente. Playground, por ejemplo, permite imágenes problemáticas a pesar de tener una política que debería prohibirlas.

Conclusión: La urgencia de medidas

La situación actual exige una respuesta inmediata y efectiva tanto por parte de Google como de los sitios de generación de imágenes por IA. Es imperativo que se desarrollen y implementen herramientas más avanzadas para identificar y eliminar contenido generado por IA inapropiado. Además, debe haber una mayor transparencia y responsabilidad por parte de estas plataformas para proteger a los usuarios y garantizar que el contenido que encuentran en línea sea seguro y veraz.

El desafío de controlar el contenido generado por IA es complejo, pero no insuperable. Con esfuerzos coordinados y un compromiso firme con la calidad y la seguridad, es posible mitigar los riesgos y restaurar la confianza en las herramientas de búsqueda en línea.